Esta dirección web esta bloqueada por el Gobierno usurpador en Venezuela, que no soporta la libertad de expresión de los ciudadanos.

Para ver actualizadas las noticias tenemos la dirección web http://www.costadelsolfm.org/ que todavía no la han bloqueado.

El pizarrón de Fran noticias

Detenidos dos chatarreros que “traficaban” 700 kilos de acero que habían recogido en Apure

Los funcionarios de la Policía del estado Apure acantonados en Guasdualito, municipio José Antonio Páez, lograron la aprehensión de dos ciudadanos ...

No incrementar el salario y la pensión del IVSS es parte del ajuste fiscal del chavismo

El economista y profesor universitario, Leonardo Vera, señaló que existe un desastre del manejo del nuevo cono monetario venezolano con el ...

Detienen a 11 venezolanos cuando intentaban ingresar clandestinamente a Aruba

La madrugada de lunes 28 de febrero 11 venezolanos fueron detenidos en altamar mientras intentaban arribar a Aruba en una embarcación.En ...

Las empresas turísticas de Rusia suspendieron los viajes a Venezuela

Venezuela, México, Cuba y República Dominicana son algunas de las rutas cuyas reservas fueron canceladas en medio del contexto por la ...

Las Academias Venezolanas se solidarizan con el pueblo de Ucrania

A través de un comunicado, Academias venezolanas expresaron este martes su solidaridad con Ucrania y los hechos acontecidos ante la invasión ...

Vladimir Putin implementó “un control de cambio” en Rusia

El presidente ruso, Vladímir Putin, prohibió hoy transferir divisas al extranjero y ordenó a las empresas con actividades económicas en el ...

El Bono de la Patria de 100 dólares para los trabajadores de Pdvsa y Cantv se quedó en anuncio

El miércoles 26 de febrero se anunció el inicio del pago del bono «corresponsabilidad y formación» para trabajadores de las empresas ...

Rusia es aún más débil de lo que la mayoría de la gente, incluido yo, creía, dijo Paul Krugman

El reconocido economista reconoció haber sobreestimado la capacidad económica y militar de Moscú y de Vladimir Putin en sus análisis previos ...

El pizarrón de Fran opinión

Humberto González Briceño: Venezuela, entre Rusia y Ucrania

La reciente avanzada militar de Rusia sobre Ucrania es un evento geopolítico complejo que no se puede despachar con el simplismo ...

Carlos Canache Mata: Jugando con el holocausto nuclear

Escribo este artículo el jueves 24 de febrero, cuando se ha consumado, en la madrugada del día, la invasión de tropas ...

José Gerardo Mendoza: Admirar y amar como forma de vida

Hay que estar bien para que los demás estén mejor y no andar repartiendo quejas ni actitudes pésimas, lastimosas y menos ...

Karina Sainz Borgo: Pablo “Corazón tan blanco” Casado

Con las manos empapadas de la sangre del rey Duncan, Lady Macbeth se dirige a su marido: «Mis manos son de ...

Pedro R. García: Latinoamérica ¿revolución socialista democracia o acedía I?

La acedía es una tristeza del bien espiritual, y su efecto propio es el quitar el gusto de la acción sobrenatural ...

María Inés Morán: Tiempos de alta productividad

Al organizar tu agenda, reserva a una misma hora del día, cada día, amplios bloques de tiempo para llevar a cabo ...

Froilán Barrios: Américo Martin y su irreverente pasión por Venezuela

Su vocación por la patria le transmitió la energía necesaria que le acompañó durante toda su vida, para asumirla y defenderla ...

Luisa Pernalete: Caminemos juntos no sólo en la iglesia

Sumario. El papa Francisco el año pasado convocó a la iglesia católica a un sínodo. Sínodo significa “caminar juntos”, para escucharnos, ...

Agustín Blanco Muñoz: Socialismo, igualdad y libertad

La desigualdad social en forma plena aparece con la propiedad. De modo que ya son siglos de lucha por el rescate ...

Eumenes Fuguet: Antonio de Nebrija, pionero de la gramática castellana

Realizados el descubrimiento y la conquista por parte del reino español, al iniciarse la colonización de los pueblos del Nuevo Mundo, ...

Ramón Guillermo Aveledo: Diálogo entre necesidad y posibilidad

Hay quienes creen que si no cambia todo, no es posible cambiar nada. Esa manera de pensar, muy revolucionaria porque no ...

Isabel Pereira Pizani: No somos iguales ¿y qué?

Con la madurez se logra entender que la superioridad objetiva de la civilización occidental es su concentración en la responsabilidad individual, ...

Política

Fundaredes exige la liberación de Javier Tarazona, tras ocho meses de prisión

Activistas de la ONG Fundaredes y miembros de la sociedad civil protestaron este miércoles en el fronterizo estado Táchira para exigir la liberación del director de esta organización, Javier Tarazona, ...

Juan Guaidó convocó a una protesta en solidaridad con Ucrania

El presidente interino, Juan Guaidó, convocó para este jueves 3 de marzo a una protesta frente a la sede de la Unión Europea en Caracas, en solidaridad con el pueblo ...

Nicolás Maduro le expresó a Vladimir Putin su firme apoyo a la operación rusa en Ucrania, dijo el Kremlin

El presidente venezolano, Nicolás Maduro, expresó este martes en conversación telefónica con su homólogo ruso, Vladímir Putin, su firme apoyo a la «operación militar especial» de Rusia en Ucrania, según ...

Es una vergüenza que Nicolás Maduro use el nombre de Venezuela para secundar la barbarie de Putin, dijo Juan Guaidó

El presidente encargado de Venezuela, Juan Guaidó, calificó como una vergüenza para los venezolanos que la dictadura de Nicolás Maduro use el nombre del país ante la Organización de las ...

Interés

Colombia acreditó 22.000 títulos universitarios de venezolanos

Lo informó el opositor venezolano Eduardo Battistini. “Con este mecanismo le hemos arrebatado a las mafias de la corrupción chavista 2.200.000 dólares”, expresóLa representación de Juan Guaidó en Colombia certificó ...

Vladimir Putin pagará un alto precio por la invasión a Ucrania, dijo Joe Biden

El conflicto de Rusia contra la población ucraniana abrió el principal discurso presidencial del año, pero la economía y una defensa de la ley de infraestructura fueron también temas centrales ...

Los rusos destruyeron la torre de televisión de Kiev y murieron 5 civiles

Antes de lanzar el ataque, el Ministerio de Defensa ruso advirtió de que iba a atacar los centros de información y propaganda en Kiev y pidió a los residentes de ...

No cambiaremos los derechos humanos por el gas de Rusia, dijo Josep Borrell

El alto representante de la Unión Europea para Asuntos Exteriores, Josep Borrell, dejó claro este martes a Rusia que la UE no va a “cambiar derechos humanos por su gas”, ...

Economía

El que tenía rublos perdió 40% de su valor

En el caso de Venezuela, acotó que parte de los recursos económicos de Pdvsa están depositados en bancos turcos, rusos y chinos.No obstante, el rublo se ha devaluado más de ...

La industria venezolana está operando al 27% de su capacidad

Aunque la baja demanda de productos nacionales (88%) sigue siendo el factor que más impacto tiene en el desempeño de las empresas durante el último trimestre de 2021, la competencia ...

El banco ruso Sberbank abandonó el mercado europeo

El mayor banco de Rusia y controlado por el Estado, Sberbank, decidió abandonar el mercado europeo ante el impacto en sus filiales en el Viejo Continente de las sanciones occidentales ...

Los Terminales de pasajeros desolados en carnaval pusieron al descubierto a la economía

Pocos iban y venían. El terminal de pasajeros de Barquisimeto permaneció ayer lunes de carnaval desolado. Choferes argumentaron que hubo destinos que ni salieron, mientras que los más solicitados fueron ...

Opinión

Gustavo Coronel: Mis profesores de geología en Tulsa resultaron ser psicólogos y filósofos

De los profesores de geología que tuve en la universidad de Tulsa recuerdo en especial a dos de ellos por razones ...

Pasqualina Curcio: Venezuela una propuesta de aumento salarial

En Venezuela, para adquirir la canasta alimentaria en un hogar de 5 personas se necesitan, por lo menos, BsD 864 (US$ ...

Román Ibarra: Ayuso el tren no pasa dos veces

Con gran angustia observo la crisis surgida en España, porque con ella, la democracia sigue sufriendo en manos de los menos ...

Luis Fuenmayor Toro: Operación mano de hierro

Las últimas medidas del gobierno contra el tráfico de drogas y de gasolina han levantado una serie de opiniones y afirmaciones, ...

Manuel Malaver: Sin revocatorio no hay paraíso

La oposición, o una parte de la oposición, se quedó sin el “referendo revocatorio”. Y todo a causa de que tres ...

Rafael Ramírez: De insurgente del 4F a policía de Maduro

El día de ayer, Diosdado Cabello, en su programa semanal de instigación al odio, arremetió en mi contra, ofendiéndome, insultándome y ...

Regional

Aumentaron los ataques con granadas para extorsionar a las empresas en el Zulia

En el transcurso del año 2021 y durante enero de 2022, el estado Zulia, ha conocido de diversos eventos de extorsión ...

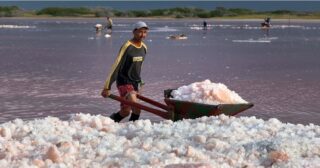

Los salineros de Las Cumaraguas protestaron por el incumplimiento de sus pagos

Decenas de trabajadores de las salinas de Las Cumaraguas, en el Municipio Falcón, estado Falcón, alzaron su voz de protesta para ...

Reportaron un sismo de magnitud 4,0 en Mérida

Un sismo de magnitud 4,0 se registró en el estado Mérida durante la madrugada de el 1 de marzo a las ...

Unos delincuentes secuestraron y asaltaron a un Buscama en la ARC

Tras despojar a las personas de sus pertenencias, en especial dólares efectivos y teléfonos celulares, los asaltantes huyeron a bordo de ...

En el municipio Guásimo del Táchira no tienen ambulancia

Urge una ambulancia para atender casos de emergencia en el municipio Guásimos. El viernes pasado, en horas de la noche, cuando ...

Denuncian deficiencia de en los servicios públicos en Biruaca

Sin gas BiruacaVarias comunidades del municipio Biruaca del estado Apure sufren la ausencia de servicios públicos, así lo denunciaron dirigentes políticos ...

Cultura

La Ciudad Universitaria el legado de Carlos Raúl Villanueva

La Ciudad Universitaria de Caracas es la sede de la Universidad Central de Venezuela y la obra más destacada del arquitecto ...

150 años se tardaron en resolver el problema matemático de las reinas del ajedrez

Michael Simkin estudió en la Universidad Hebrea de JerusalénEs muy probable que cuando en 1848 el ajedrecista alemán Max Bezzel concibió ...

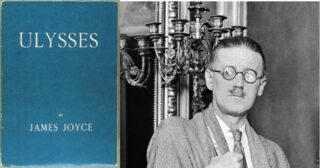

100 años de “Ulises” la obra de James Joyce de ser obscena y tonta a la mejor novela del siglo XX

En la primavera de 1921, la librera parisina Sylvia Beach se jactó de sus planes de publicar una novela que consideraba ...

María Fernanda Brea de Catia al Palais Garnier en París

Para la venezolana, nacida en los Frailes de Catia en Caracas; Venezuela, medirse con los mejores cantantes de ópera del mundo ...

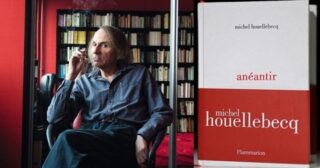

Michel Houellebecq presentó su nueva novela Aniquilar

Con su última obra, Houellebecq completa su concepto literario: contar historias de hombres blancos en el patriarcado. La sorpresa llega al ...

UPEL / Revista Espacio y Tiempo: Historia naval de Venezuela

PresentaciónHistoria naval y la historia de las relaciones civiles-navales en Venezuela e Hispanoamérica de los siglos XVII, XVIII, XIX Y XX ...

Consejos de una enfermera inglesa para los contagiados con el virus Covid -19

Para evitar el Covid -19 estas recomendaciones hemos oído: Lávese bien sus manos Buena higiene personal Mantenga una distancia apropiada de otras personas Eso está ...

De utilidad

11 plataformas de educación online gratuitas y en español que los países nórdicos liberaron por la pandemia

Ante la pandemia de Covid-19 y el cierre masivo de instituciones educativas, los países nórdicos han liberado herramientas educativas online. BBC News Mundo: Coronavirus: 11 ...

Todos los sitios legales para descargar libros gratis

Los libros electrónicos poco a poco han ido ganando popularidad. Ya sea por su precio, portabilidad o porque son más amigables con el medio ambiente, ...

Algo más

Cómo funciona nuestro sistema inmunológico y cómo combate al coronavirus

Sin una vacuna y sin un tratamiento específico efectivo, la única arma que tenemos para defendernos del coronavirus en nuestro sistema inmunitario. Te contamos cómo ...

Deyna Castellanos comienza con buen pie su carrera profesional en el Atlético de Madrid

La vinotinto Deyna Castellanos, ya inició su carrera profesional con triunfos en la liga profesional de fútbol femenino de España. Debutó con su equipo, el ...

Según Eumenes Fuguet

Eumenes Fuguet: Antonio de Nebrija, pionero de la gramática castellana

Realizados el descubrimiento y la conquista por parte del reino español, al iniciarse la colonización de los pueblos del Nuevo Mundo, se impuso la religión ...

lo que hay que leer

Humberto González Briceño: Venezuela, entre Rusia y Ucrania

La reciente avanzada militar de Rusia sobre Ucrania es un evento geopolítico complejo que no se puede despachar con el simplismo de apoyar o de ...

Carlos Canache Mata: Jugando con el holocausto nuclear

Escribo este artículo el jueves 24 de febrero, cuando se ha consumado, en la madrugada del día, la invasión de tropas rusas a Ucrania y ...

Abraham Gómez R.: Nuestra universidad; Indoblegable e insumisa

Cuántos personajes, ayer como hoy, han apelado a los ardides más inimaginables para intentar “arrodillar” a las instituciones dispensadoras de Educación Superior; con lo cual ...

Documentos

No se han encontrado entradas.